IT之家 10 月 2 日音书开云kaiyun.com,据 PyTorch 新闻稿,PyTorch 旗下架构优化库 torchao 现已沉静发布,该优化库主要专注于模子的量化和稀零性优化,粗略在保证性能的同期裁汰模子的计较资本和 RAM 用量,从而普及模子启动后果,IT之家附 GitHub 页面地址(点此走访)。

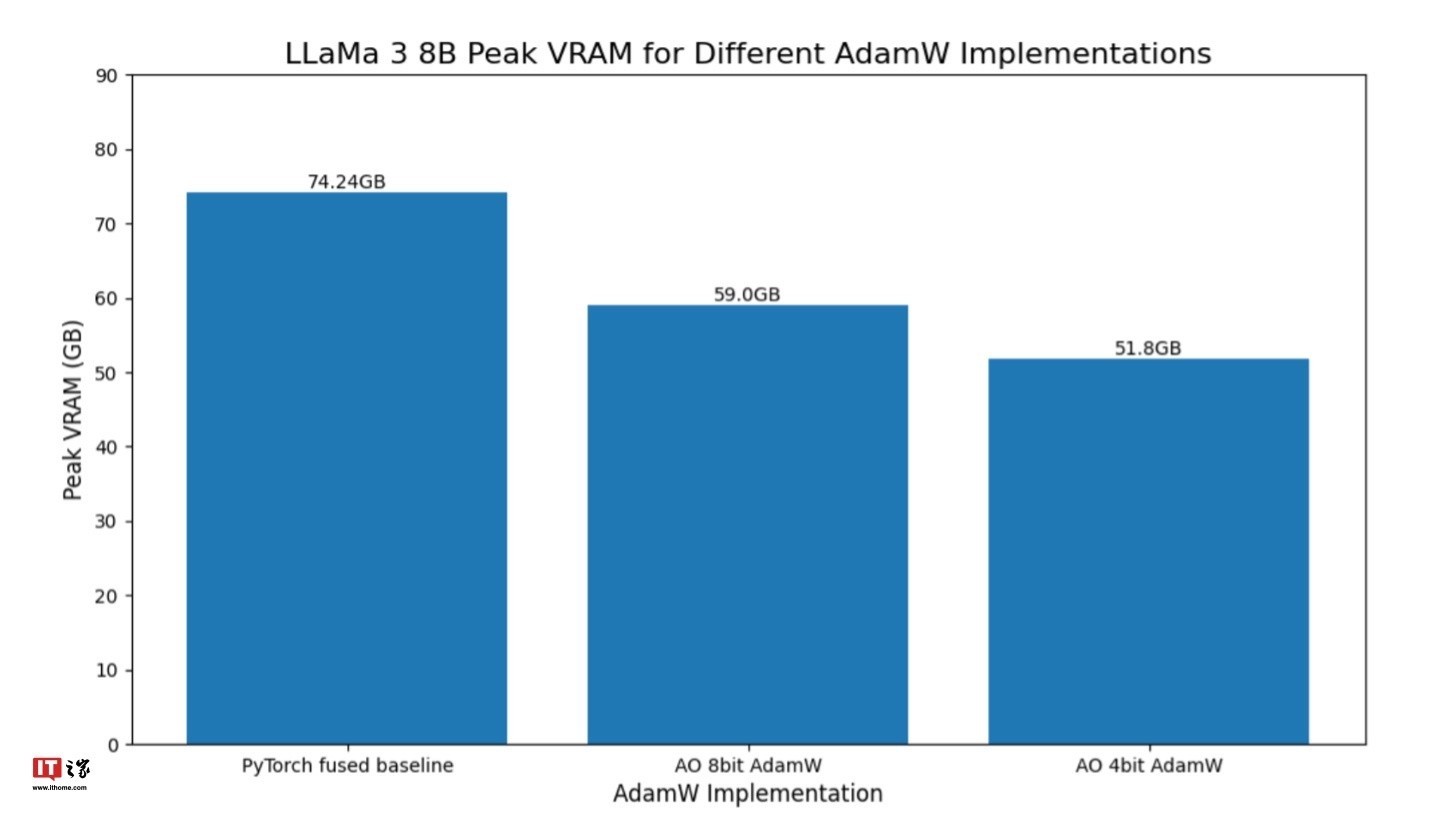

据先容,torchao 提供了一系列优化器用集,不错匡助 LLaMA 3 等流行的 AI 模子普及性能,其扶直 float8、int4 等低精度数据类型,粗略灵验减少硬件支拨和 RAM 用量。

官方例如,在 LLaMA 3 70B 模子的预训练中,torchao 提供的 float8 训练历程可将模子计较速率普及 1.5 倍。斥地者只需行使 convert_to_float8_training 函数,即可将模子训练调度为 float8,从而轻视齐全模子高效训练。

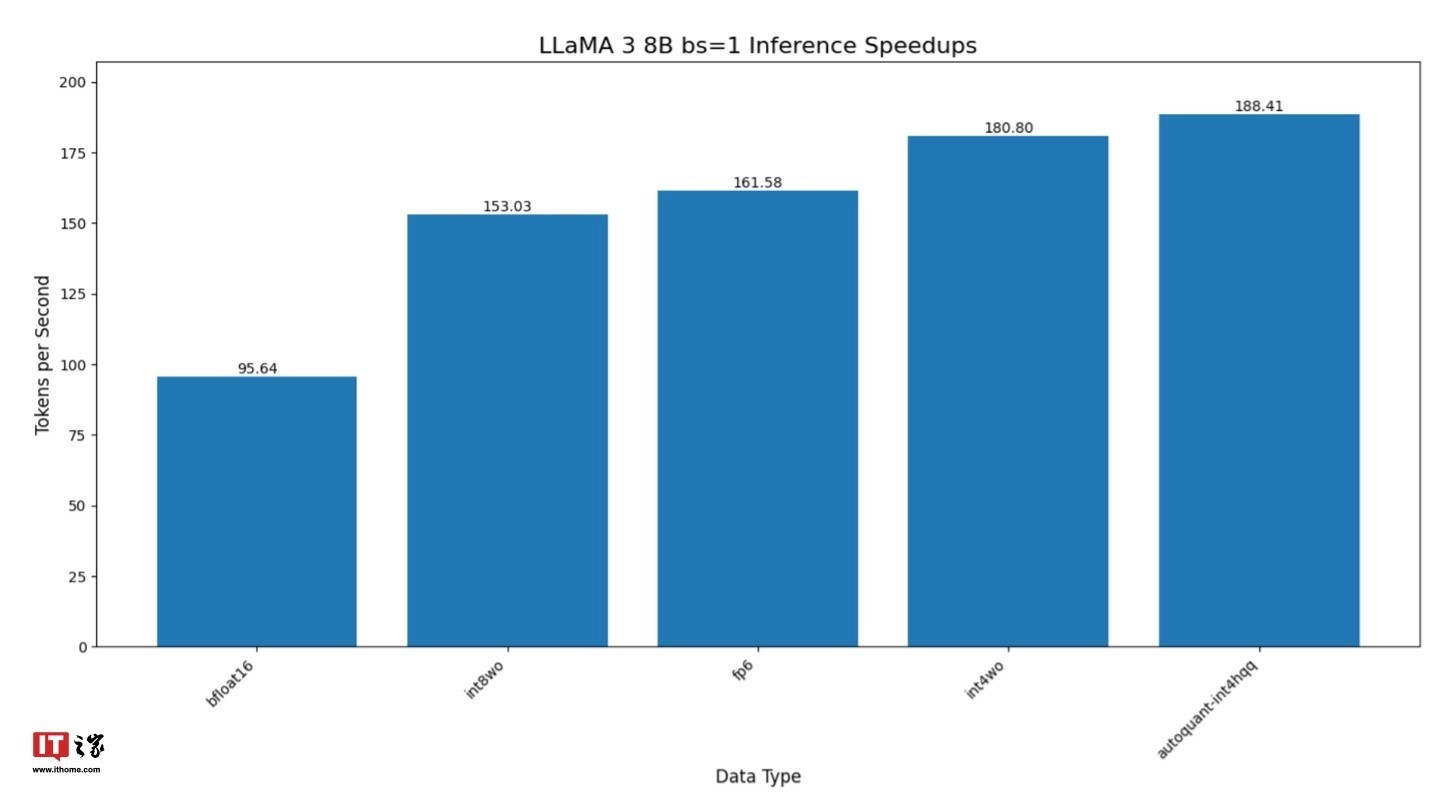

在推理方面,torchao 提供多种量化法式,包括权分量化(Weight-Only Quantization)和动态激活量化(Dynamic Activation Quantization),用户不错自有遴荐顺应的量化战术,以得回最好的模子推感性能。

在稀零性优化方面, torchao 不错优化模子参数计较后果,据称可让 ViT-H 模子的推理速率普及 5%。同期,torchao 还不错将权分量化为 int4,并将键值缓存量化为 int8,可令 LLaMA 3.1 8B 在无缺的 128K 高下文长度下仅占用 18.9GB 的显存。

开云kaiyun.com

开云kaiyun.com